現在の AI データセンターは、スケーリングにおいて 2 つの主要なボトルネックに直面しており、従来のスケールアップ モデルとスケールアウト モデルでは、ギガ-規模の AI 需要を満たすのに苦労しています。

スケールアップの制限-: 単一のシステムまたはラックをアップグレードすることで実現できますが(GPU 数の増加や単一デバイスのパフォーマンスの向上など)、水冷などのインフラストラクチャによる電力上限によって制限されます。既存のデータセンターには電力入力と熱放散に対する物理的なしきい値があり、ラックまたはデータセンターごとのコンピューティング密度が無限に増加することを妨げています。

スケールアウトの制限-:クラスタを拡張するためにラックとサーバーを追加することで拡張されますが、単一会場の物理スペースによって制限され、機器の容量に厳しい制限が課されます。

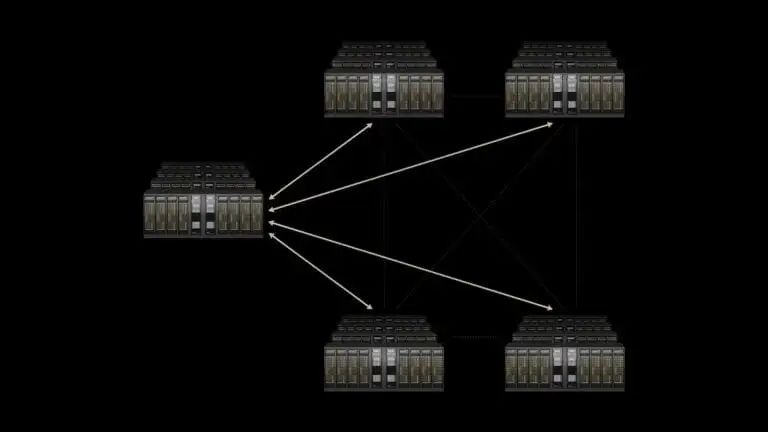

このジレンマを克服するために、NVIDIA は、地理的に分散したデータセンター間のネットワーク通信を最適化し、分散 AI クラスタを 1 つとして連携させる「スケールアクロス」という新しい次元を提案しています。{0} NVIDIA の創設者兼 CEO の Jensen Huang 氏は、この-地域をまたいだ AI スーパー ファクトリーは、Spectrum{3}}XGS を中核技術の実現要素とする AI 産業革命の重要なインフラストラクチャであると説明しています。

Spectrum のコア テクノロジー-XGS

Spectrum-XGS はまったく新しいハードウェア プラットフォームではなく、NVIDIA の既存の Spectrum-X イーサネット エコシステムの進化版です。 2024 年の発売以来、Spectrum-X は、Spectrum-4 アーキテクチャの SN5600 スイッチと BlueField-3 DPU を介して、従来のイーサネットよりも 1.6 倍高い生成 AI ネットワーク パフォーマンスを実現しており、NVIDIA GPU を使用する AI データセンターの主流の選択肢となっています。 Spectrum-XGS の画期的な点は、リージョンをまたがる GPU クラスターにおける通信遅延、輻輳、同期の課題に対処する 3 つのアルゴリズムの革新とハードウェアの相乗効果にあります。

1.コア アルゴリズム: 長距離ネットワーク特性への動的適応-

Spectrum-XGS の中核は、クロス-データ-センター通信の重要なパラメータ(距離、トラフィック パターン、混雑レベル、パフォーマンス指標)をリアルタイムで分析し、ネットワーク ポリシーを動的に調整する一連の「距離{1}}対応ネットワーク最適化アルゴリズム」です。-

距離-適応型渋滞制御:従来のイーサネットによるすべての接続の均一な処理とは異なり、Spectrum{0}XGS アルゴリズムは、データセンター間の実際の距離に基づいて輻輳しきい値を自動的に調整し(現在、最大数百キロメートルの導入をサポートしています)、長距離伝送でのパケット損失や蓄積を回避します。-

正確な遅延管理:-パケット単位のきめ細かい適応ルーティングにより、従来のネットワークでのパケット再送信による遅延ジッターを排除します。{1}ジッターは AI クラスターにおける重大な危険です。遅延により 1 つの GPU が遅れた場合、連携しているすべての GPU は待機する必要があり、全体のパフォーマンスに直接影響します。

エンドツーエンドテレメトリ-}-: GPU からスイッチおよびクロス-データ-リンクへのフルリンク パフォーマンス データのリアルタイム収集-により、アルゴリズム調整のためのミリ秒-}レベルのフィードバックが提供され、ネットワーク ステータスと AI ワークロードの需要の動的な一致が保証されます。

2. ハードウェアの相乗効果: Spectrum-X エコシステムの高帯域幅基盤の活用-

Spectrum-XGS は、特定の NVIDIA ハードウェアと組み合わせると最適なパフォーマンスを実現します。

スペクトラム-X スイッチ: 基盤となるネットワーク バックボーンとして、高いポート密度と低レイテンシの転送を提供します。{0}

ConnectX-8 SuperNIC: GPU とスイッチ間の高速データ転送のための 800 Gb/s AI- 専用ネットワーク アダプタ。-

ブラックウェル アーキテクチャ ハードウェア: B200 GPU や GB10 スーパーチップなど、Spectrum-XGS と緊密に統合され、エンドツーエンドのレイテンシを削減します。-- NVIDIA は、NCCL (集団通信ライブラリ) ベンチマークを通じて検証しました。Spectrum-XGS は、クロス-データセンター-GPU 間の通信パフォーマンスを 1.9 倍向上させ、エンドツーエンドのレイテンシを約 200 ミリ秒-と感じられるレベルに制御します。 ユーザー インタラクションに対して応答性が高く、遅延がなく、-AI 推論のリアルタイム要件を満たします。-

-Spectrum による AI トレーニングと推論効率のためのフルスタック最適化-XGS

Spectrum-XGS は独立したテクノロジーではなく、NVIDIA のフルスタック AI エコシステムへの重要な追加要素です。-このリリースで、NVIDIA は、ハードウェア-アルゴリズム-ソフトウェア コラボレーションのための Spectrum-XGS と相乗効果を発揮するソフトウェア-レベルのパフォーマンスの強化も明らかにしました。

Dynamo ソフトウェアのアップグレード: Blackwell アーキテクチャ (B200 システムなど) に最適化され、AI モデル推論のパフォーマンスが最大 4 倍向上し、大規模モデル推論のコンピューティング消費量が大幅に削減されます。

投機的デコード技術: 小さなドラフト モデルを使用して、メイン AI モデルの次の出力トークンを事前に予測し、メイン モデルの計算を削減し、推論パフォーマンスをさらに 35% 向上させます。これは、大規模言語モデル (LLM) での会話推論シナリオに特に適しています。

NVIDIA のアクセラレーテッド コンピューティング部門ディレクターの Dave Salvator 氏は、これらの最適化の中核目標は、野心的なエージェント AI アプリケーションを拡張することであると述べました。兆-パラメータの大規模モデルをトレーニングする場合でも、数百万の同時ユーザーに対する AI 推論サービスをサポートする場合でも、Spectrum-XGS とソフトウェア エコシステムの組み合わせにより、予測可能なパフォーマンスが実現します。

スペクトラムの初期のアプリケーションと業界への影響-XGS

最初のユーザー: CoreWeave Pioneers クロス-ドメイン AI スーパー ファクトリーGPU クラウド サービス プロバイダである CoreWeave は、Spectrum-XGS を最初に採用した企業の 1 つです。同社の共同創設者兼最高技術責任者(CTO)の Peter Salanki 氏は、このテクノロジーにより顧客はギガスケールの AI 機能にアクセスできるようになり、業界全体のブレークスルーが加速されると述べました。{3}たとえば、Oracle、SoftBank、OpenAI による Stargate イニシアチブのような超-大規模-AI プロジェクトをサポートします。

業界トレンド: AI ネットワークの主流として InfiniBand に代わるイーサネットInfiniBand は 2023 年に AI バックエンド ネットワーク市場の約 80% を占めていましたが、業界は急速にイーサネットに移行しています。 NVIDIA が Spectrum-XGS on Ethernet を開発するという選択は、この傾向に沿ったものです。

互換性とコストの利点:イーサネットはグローバル データ センターの普遍的な標準であり、ネットワーク エンジニアにとって馴染みがあり、InfiniBand よりも導入コストが安くなります。

市場規模の予測:Dell'Oro Group のデータによると、イーサネット データセンター スイッチ市場は今後 5 年間で 800 億ドル近くに達すると予想されます。

NVIDIA 自身の成長: 650 Group のレポートによると、NVIDIA は 2024 年のデータセンター スイッチ市場で「最も急成長しているベンダー」であり、そのネットワーキング ビジネスの収益は第 2 四半期 (4 月 27 日まで) に 50 億ドルに達し、前年同期比 56% 増となります。--。

Spectrum{0}}XGS の開始により、AI インフラストラクチャにおける NVIDIA のフルスタック独占戦略が拡張されると同時に、新たな競争力学が引き起こされます。-

NVIDIA のフル-スタック レイアウト: GPU (Blackwell)、相互接続 (NVLink/NVLink スイッチ)、ネットワーク (Spectrum-X/Spectrum-XGS、Quantum-X InfiniBand) からソフトウェア (CUDA、TensorRT-LLM、NIM マイクロサービス) まで、NVIDIA は形成されています AI インフラストラクチャの「コンピューティング-接続-ソフトウェア」をカバーする閉ループ。 Spectrum-XGS は NVLink と連携して、ラック内 (NVLink)、ラック内 (NVLink)、データセンター内 (Spectrum-X)、-の 3 つのレベルのスケーリングを実現します。 クロス-データ-センター(Spectrum-XGS)。

競合他社の反応: Broadcom の初期の SUE テクノロジーは、Spectrum-XGS と同様の目標を共有し、イーサネットのパフォーマンスを最適化して InfiniBand との差を埋めることを目指しています。さらに、Arista、Cisco、Marvell などのベンダーは AI- 専用イーサネット スイッチの開発を加速しており、競争はパフォーマンス-コスト-エコシステムとの互換性を重視しています。

Spectrum-XGS の中核となる価値は、AI データセンターの拡張を「単一サイトの制約」から「地域を越えたコラボレーション」に推進することにあります。-単一のデータセンターでは電力と土地が厳しい制限になるため、都市間および国を越えた AI スーパー ファクトリーが、次世代 AI アプリケーション(一般的な人工知能、大規模なエージェント クラスタなど)をサポートする中核となるでしょう。{6}{6}

NVIDIA のネットワーキング部門上級副社長、Gilad Shainer が Hot Chips カンファレンスでプレビューしたように、「クロス-データ-センターの光ファイバー物理ネットワークは古くから存在していましたが、Spectrum-XGS のようなソフトウェア アルゴリズムが、これらの物理インフラストラクチャの真のパフォーマンスを引き出す鍵となります。」